Искусственный интеллект наступает — это факт. Одни активно подключают его к решению разных задач, другие используют только в работе или в быту, третьи стараются минимизировать его присутствие в своей жизни. Но каким бы ни было отношение к ИИ, соприкасаться с ним сегодня приходится практически всем. Некоммерческий сектор не исключение.

«Мы привыкли, что коммуникация в НКО — с партнерами, донорами, благополучателями, со СМИ — это формат ”человек — человек”, — говорит Екатерина Васильева, главный редактор Агентства социальной информации. — Но с появлением искусственного интеллекта, кажется, этот формат начинает меняться».

О рисках и доверии, о моральных и юридических вопросах, а также о том, каким мог бы быть кодекс этики использования ИИ в НКО, говорили участники конференции «Медиа/НКО}профи» на сессии «Социальное доверие и социальные коммуникации в эпоху нейросетевой революции».

Доверие, эмоции и вечный вопрос «говорить ли ИИ спасибо?»

Центр цифровых культур и медиаграмотности ВШЭ в течение трех лет проводил опросы представителей образования и креативных индустрий — тех сфер, где искусственный интеллект в первую очередь рванул вперед. Три волны анкетирования позволили увидеть динамику вхождения, распространения и освоения ИИ.

«Один из выводов, к которому мы пришли, проанализировав ответы наших респондентов, что пространство генеративного искусственного интеллекта — это все-таки пространство диалога, — говорит Светлана Шомова, профессор факультета креативных индустрий НИУ ВШЭ, руководитель проекта Центра цифровых культур и медиаграмотности НИУ ВШЭ. — Мы, белковые сущности (уже есть и такой термин), начинаем разговаривать, взаимодействовать с алгоритмами».

Исследование рассматривало разные стороны этого «общения», в том числе — доверие и эмоции. Например, делегировать решения пользователи готовы в первую очередь в управлении умным домом и бытовыми приборами, потом в системах доставки и ЖКХ (быстрые оплаты), а вот в применении к банковской сфере есть опасения.

Более открыты к ИИ креативщики, а у преподавателей доверия меньше. «Я, например, пользуюсь, но пришла к выводу, что в рабочих целях дешевле все сделать с нуля самой, чем потом перепроверять и переделывать», — делится личным опытом Светлана Шомова.

Выяснилось, что респонденты дают имена роботам-пылесосам, музыкальным колонкам и другим электронным помощникам, и, как показывает исследование, со временем все больше людей начинают испытывать эмоции при взаимодействии с ИИ. Если раньше его воспринимали в первую очередь как инструмент, то теперь пользователи говорят, что могут испытывать разные чувства — от недовольства и гнева до восторга и умиления. Опросы показали, что некоторые даже обсуждают с Алисой личную жизнь и ждут от нее советов. При этом психологи не дают однозначного ответа, насколько хорошо или плохо очеловечивание гаджета: для ребенка оно может быть опасно, а для пожилого одинокого человека — стать благом.

«Предмет многих споров — говорить ли ИИ спасибо. Лично я считаю, что если человек привык благодарить за добро, то почему бы не сказать спасибо искусственному интеллекту. Коллеги мои мне на это говорят, что я уже впала в антропоморфизм», — рассказывает Светлана Шомова.

«Есть две прямо противоположных точки зрения. С одной стороны, каждое лишнее спасибо действительно отнимает много ресурсов у искусственного интеллекта. Но при этом были англоязычные исследования, которые показали, что ИИ лучше нас понимает, когда мы с ним вежливы. Не потому, что он такой хороший, а просто потому, что обучался на литературном языке и дает более адекватные ответы, когда с ним разговаривают корректно».

Фото: Мария Муравьева / АСИ

Куда катится фандрайзинговый мир и кто принимает решения

Есть и другие лайфхаки, как заставить нейросеть дать лучший ответ, рассказывает Михаил Письменный, основатель сервиса для фандрайзинга GIVR и активный пользователь IT. По его словам, можно попросить «не экономить токены», «призывать к совести», манипулировать тем, что от ответа зависит очень многое, или говорить, что другая нейросеть справилась с той же задачей лучше.

Можно настроить и обучить искусственный интеллект под свои задачи так, что он действительно станет незаменимым помощником. Так технологии помогают платформе GIVR увеличивать суммы и частоту пожертвований и уменьшать количество отписок.

«Машины отслеживают поведение доноров и триггеры, которые срабатывают, — говорит Михаил Письменный. — Каждому донору мы показываем уникальные цифры пожертвования, и это помогает поднять коэффициент конверсии. Мы делаем персонализированные рассылки, понимая, когда человек читает, на что реагирует, система сама готовит тексты и отбирает тематику. Условно, если идет сбор на лечение женщины от рака груди, то письма не отправляются молодым мужчинам, потому что эта проблема им не близка, и за счет этого мы экономим деньги на рассылку и повышаем отклик. Такие алгоритмы и механизмы — это уже не фантастика, не магия, а то, куда идет вообще весь фандрайзинговый мир».

Нейросети позволяют выстроить трек общения с десятками тысяч доноров и для каждого из них создать персональное коммуникативное сообщение. Десятки метрик отображают поведение человека. И, по словам основателя платформы, все это помогает фондам, пользующимся такого рода сервисами, кратно увеличивать конверсию.

Что же касается свободы выбора и влияния искусственного интеллекта на поведение человека, то тут у Михаил Письменного позиция простая:

«Если у кого-то есть иллюзия, что он принимает какие-то решения в этом мире, хочу ее развеять. Потому что на самом деле алгоритмы давно уже определяют за нас, какую музыку мы слушаем, какие фильмы смотрим, куда ездим, в какие рестораны ходим. А искусственный интеллект дает больше возможностей, он может принимать эти решения за вас, а вам становится проще с этим жить».

Фото: Мария Муравьева / АСИ

А он и гранты за НКО писать будет?

«Не надо думать, будто мы мучим людей, когда просим деньги. Да, мы такие, мы про благотворительность, — говорит Мария Соловьева, руководитель подпрограммы ”ИИ в НКО” программы ”Кухня НКО” благотворительного фонда ”Добрый город Петербург”. — Но информация должна подаваться максимально корректно, а у человека оставаться возможность самому выстраивать личные границы и систему фильтрации. Если информация не нравится и не нужна, он может отписаться, пролистать, пойти дальше».

Бездумное использование искусственного интеллекта в сфере благотворительности порождает большое количество низкокачественных текстов, может притуплять критическое мышление и влиять на репутацию организации. В то же время технологии могут значительно облегчить жизнь НКО при использовании их в написании грантовых заявок. Программа «Кухня НКО» провела исследование этой области применения ИИ.

«Три четверти респондентов использовали генеративные нейросети при подготовке описания проблемы — той сложной концептуальной части заявки, которая вызывает у подавляющего большинства авторов определенные сложности, — рассказывает Мария Соловьева. — Примерно половина использовала ИИ при формулировке целей и задач — тоже достаточно абстрактной вещи, которая дается не очень легко. Треть — для описания результатов проекта».

55% участников опроса совсем не использовали ИИ при подготовке грантовых заявок. 32% попробовали и отредактировали, еще 13% — попробовали, но не рискнули включить в заявку. 1% без всякой переработки вставили сгенерированный текст. «Полагаю, что положительного исхода у таких заявок не было», — подводит итог Мария Соловьева.

Авторы исследования также узнали мнения грантрайтеров и экспертов о том, что допустимо, а что нет при использовании искусственного интеллекта как для подготовки заявок, так и для их оценки, а затем составили свой «манифест» фонда, в котором описали, где считают целесообразным его применение. Одно из важнейших требований — обязательное указание в случае использования ИИ в грантовой заявке, обоснование, а также ссылки на реальные источники. «Искусственный интеллект сам по себе источником являться не может», — подчеркивает Мария Соловьева.

Критическая масса и манная каша

Произведения (например, тексты и картинки), созданные искусственным интеллектом, также не являются сейчас и объектами авторского права. Но есть нюансы и риски, которые пока никак не регулируются. Закон не обязывает маркировать ИИ-контент, но иногда сложно различить, кто действительно его автор — человек или машина. Нарушение действующего закона может быть в пограничных ситуациях, когда человек включается и дорабатывает то, что сделал ИИ, или, наоборот, с помощью него видоизменяет чье-то оригинальное изображение.

«Технологии всегда идут впереди закона, — говорит Светлана Кузеванова, медиаюрист. — Сейчас государство в первую очередь направляет усилия на регуляцию в части использования ИИ в преступных, мошеннических целях. Все остальное — это пока вопрос открытый, дискуссионный».

Что касается аналитики, а не творческого контента, то, например, заменить консультацию юриста ИИ не может. «Когда я вижу тот анализ, который он мне предлагает на юридические запросы, мне просто плохо, — говорит специалист. — Я часто слышу, что он обучается на своих собственных ошибках. И мне кажется, когда-то наступит какой-то критический момент, когда там нарастет достаточная масса, чтобы он или стал идеальным, или, наоборот, провалился на дно».

Фото: Мария Муравьева / АСИ

Ответственность за ошибки ИИ все равно на человеке, который принял решение об использовании полученной от него информации и ее распространении. И пока выбор добровольный, это еще не настолько большая проблема. «Если мы сами определяем, будет ли у нас в доме Алиса и использовать ли ИИ для подготовки документов, — это одна история. Когда нас будут обязывать с его помощью что-то делать — и это уже частично происходит, — вот здесь могут быть уже более глобальные трудности», — отмечает юрист.

Но если посмотреть на тренды, то в конечном итоге наступит толерантность к контенту, созданному искусственным интеллектом, считает Михаил Письменный: «Те, кто сегодня пишут сами, со временем сдадутся. Потому что в 2025 году 75% нового контента, созданного в интернете, было сгенерировано с помощью искусственного интеллекта, и только 25% написано людьми. Это статистика миллиона новых веб-страниц. Потому что если выбирать между автором, который напишет за какую-то сумму две хорошие статьи, и ИИ-агентом, который напишет сто статей, из них восемь, например, хороших, а остальные — плохие, то эти восемь дадут тот же эффект, что и человек, да еще и бесплатно. Мы можем быть против этого, я сам люблю писать и читать хорошие тексты, но это станет новой нормой».

Противостоять этому натиску действительно сложно, говорит Инна Кравченко, заместитель главного редактора портала «Такие дела». При этом в издании тоже экономят бюджет с помощью созданных ИИ иллюстраций, но считают, что журналистские тексты заменить не получится. ИИ не сможет с метафорикой и иронией рассказывать истории и говорить на сложные темы, как может это делать хороший автор.

«Проблема сегодня заключается в том, что всем нам приходится, как сквозь манную кашу, пробиваться через белый шум, который в том числе помогает генерировать искусственный интеллект, — говорит редактор. — И этой манной каши с каждым днем пребывает все больше и больше, количество усредненного или вообще никакого контента растет, и в том числе это подрывает доверие внутри сферы НКО и притупляет восприятие читателя.

Фото: Мария Муравьева / АСИ

Мы находимся в том пороговом периоде, когда ИИ еще несовершенен, а мы мало того что должны его учить, так еще и должны расхлебывать те проблемы, которые возникают от его использования».

Одно из опасений — не получится ли, что с такими тенденциями через несколько лет нынешние студенты, в том числе факультативов журналистики, не будут ничего уметь без электронных шпаргалок?

«Такой риск есть, — говорит Светлана Шомова, обучающая в том числе журналистов и медиакоммуникторов. — Мы иногда даем студентам задание посмотреть фильм и написать рецензию самому, а потом задать промпт, чтобы ее написал ИИ. Обычно они говорят: ”У него души нет, что он там напишет?” А потом некоторые приходят и отмечают, что он написал лучше их самих.

Некоторые и сейчас пишут хуже искусственного интеллекта, а у некоторых всегда будут ирония и легкость, их тексты отличающие. То есть это вопрос таланта и индивидуальности, которые и в прежние времена не были такой жар-птицей, которая летает стаями».

Встречное движение

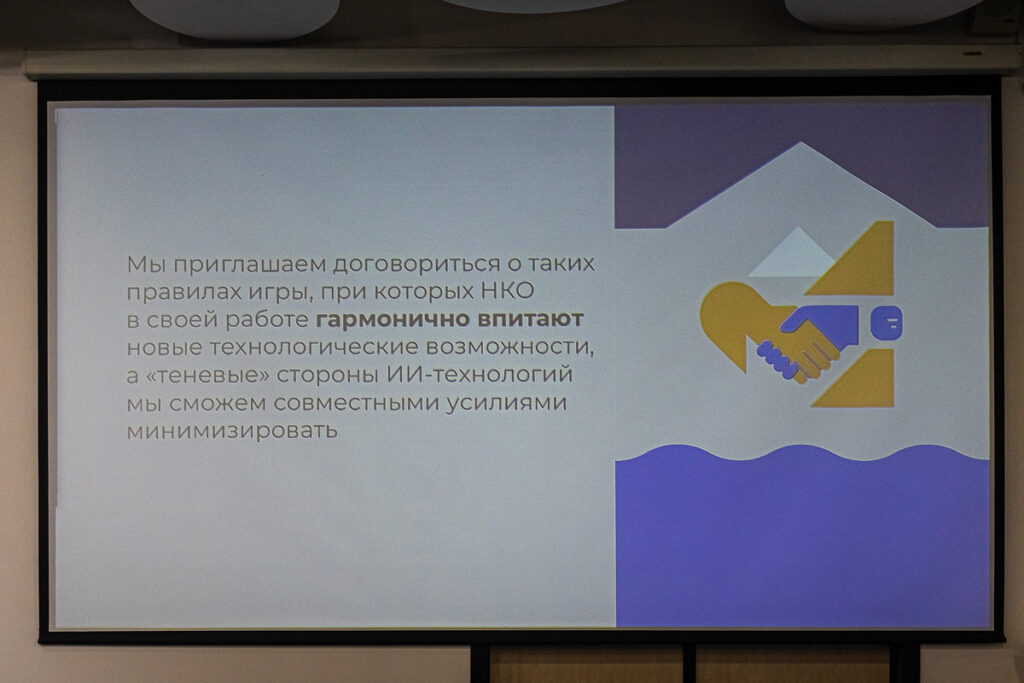

«В целом мы поддерживаем направление работы с ИИ и верим, что оно может усилить работу некоммерческих организаций и еще лучше помогать нашим благополучателям, но строим свое осознанное отношение, имеем в виду неоднозначности и риски, связанные с его использованием», — озвучивает Мария Соловьева подход, выработанный программой «Кухня НКО».

Помочь выстраивать диалог НКО и ИИ мог бы кодекс этики. Участники дискуссии считают, что в нем должны быть учтены такие вопросы, как маркировка, качество информации и ее достоверность, защита данных, а также важно интегрировать в него заповедь «не навреди».

Интересно, что сама нейросеть, которую ведущая дискуссии Екатерина Васильева заранее попросила также составить подобный кодекс, предложила классифицировать риски, напомнила об ответственности человека и сама учла некоторые из аспектов, которые были озвучены в зале.

Еще один символичный момент — картинка, которую попросила сгенерировать искусственный интеллект для отображения взаимодействия НКО и ИИ Мария Соловьева. «Наверное, это метафора тех продуктов, которые нам создает сейчас нейросеть, — говорит она. — Миленько, страшненько — и совершенно точно с этим как-то надо работать дальше, чтобы это приняло некую приемлемую форму».

Организаторы конференции «Медиа/НКО}профи» — Агентство социальной информации и Центр «Благосфера». В 2025 году конференция проводится при поддержке Фонда президентских грантов (проект «Проводники социальных изменений») и Благотворительного фонда Владимира Потанина (проект «НКО-профи»).